将您的应用暴露给任意 AI

为您的 Nuxt 应用添加模型上下文协议(MCP)服务器。以类似 Nitro 的开发体验,将您的功能连接到 AI 客户端。

让您的应用对 AI 开放

使用模型上下文协议来标准化 LLM 与您的 Nuxt 应用的交互方式。

- 立即开始构建

只需编写代码

使用标准的 TypeScript 文件定义工具、资源和提示词。无需复杂的配置或样板代码。

- 工具创建可执行函数,使 AI 模型能够执行操作并检索信息。

- 资源共享数据,如文件、数据库记录或 API 响应,作为 AI 模型的上下文。

- 提示词构建可重用的模板和工作流,以指导 AI 交互并标准化使用。

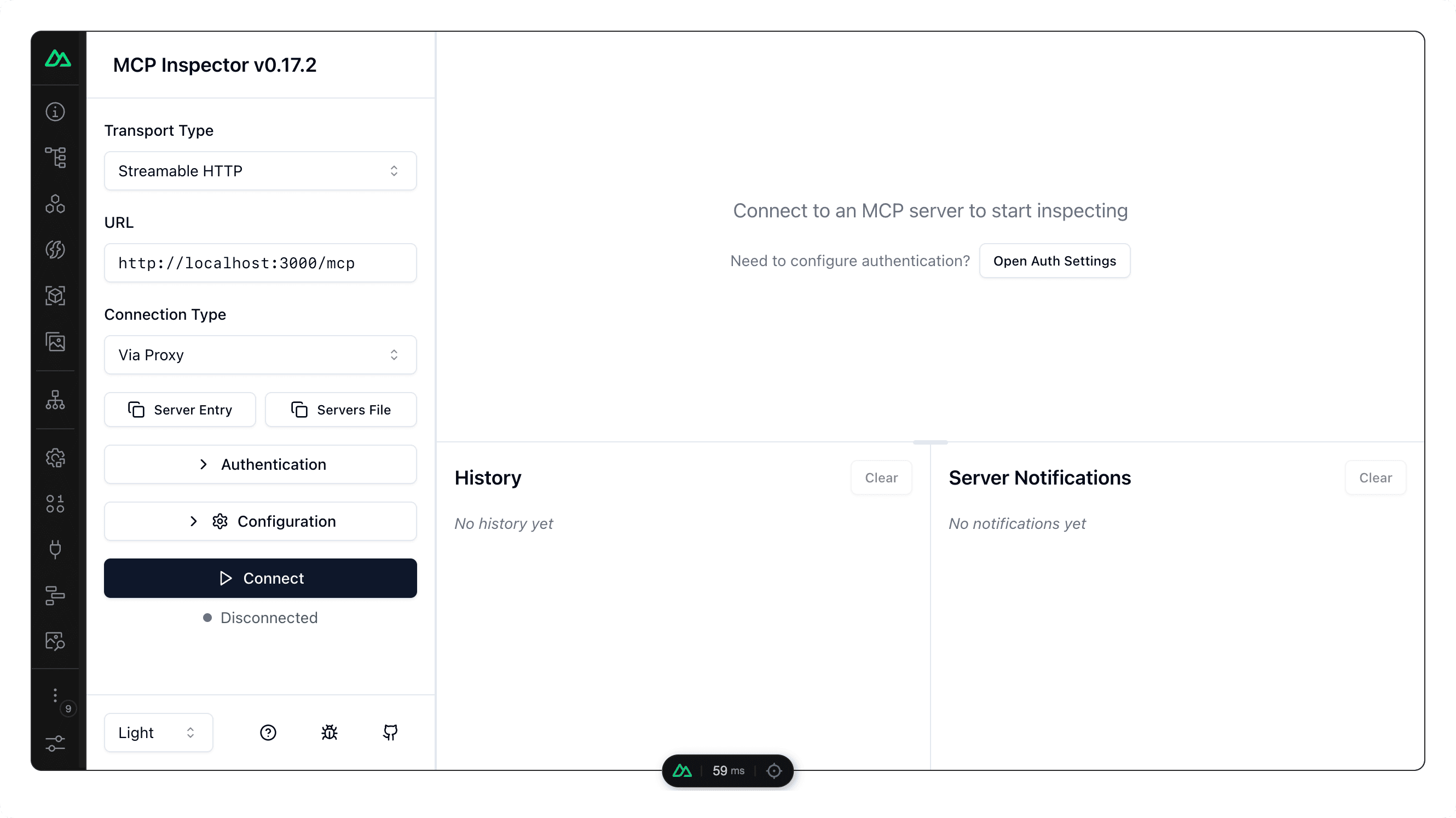

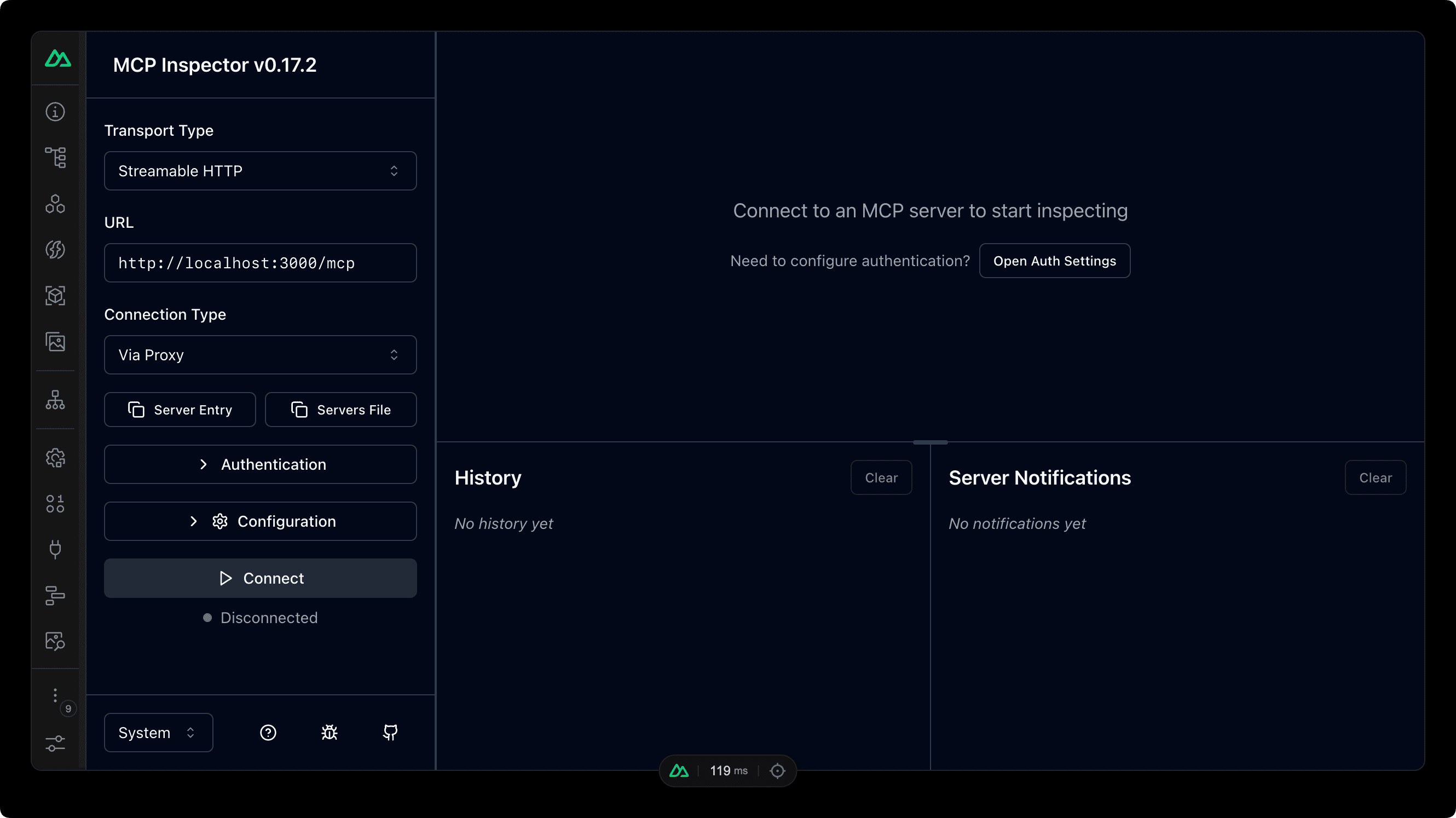

内置检查器

实时调试您的 MCP 服务器。查看已注册的工具、资源和提示词,并监控客户端连接和请求日志。

准备好构建您的第一个 MCP 服务器了吗?

通过我们全面的指南和示例,在几分钟内快速上手。